라마 4 제품군 출시

본 글은 AI Times에서 발췌했습니다. 원문은 하단 링크를 참고하세요.

2025년 4월 5일, 멀티모달 기능을 갖춘 '라마 4' 제품군을 출시했다. 오픈AI나 구글 등의 최첨단 모델과 맞먹는 성능을 갖춘 것은 물론, 멀티모달 기능을 통해 '오픈 소스 최강'의 위치를 되찾으려고 시도한 점이 특징이다. 이 중 스카우트와 매버릭은 이날부터 라마닷컴과 허깅페이스에서 다운로드할 수 있다

메타는 5일(현지시간) ▲라마 4 스카우트(Scout) ▲라마 4 매버릭(Maverick) ▲라마 4 베히모스(Behemoth) 등 멀티모달 제품군을 공개했다.

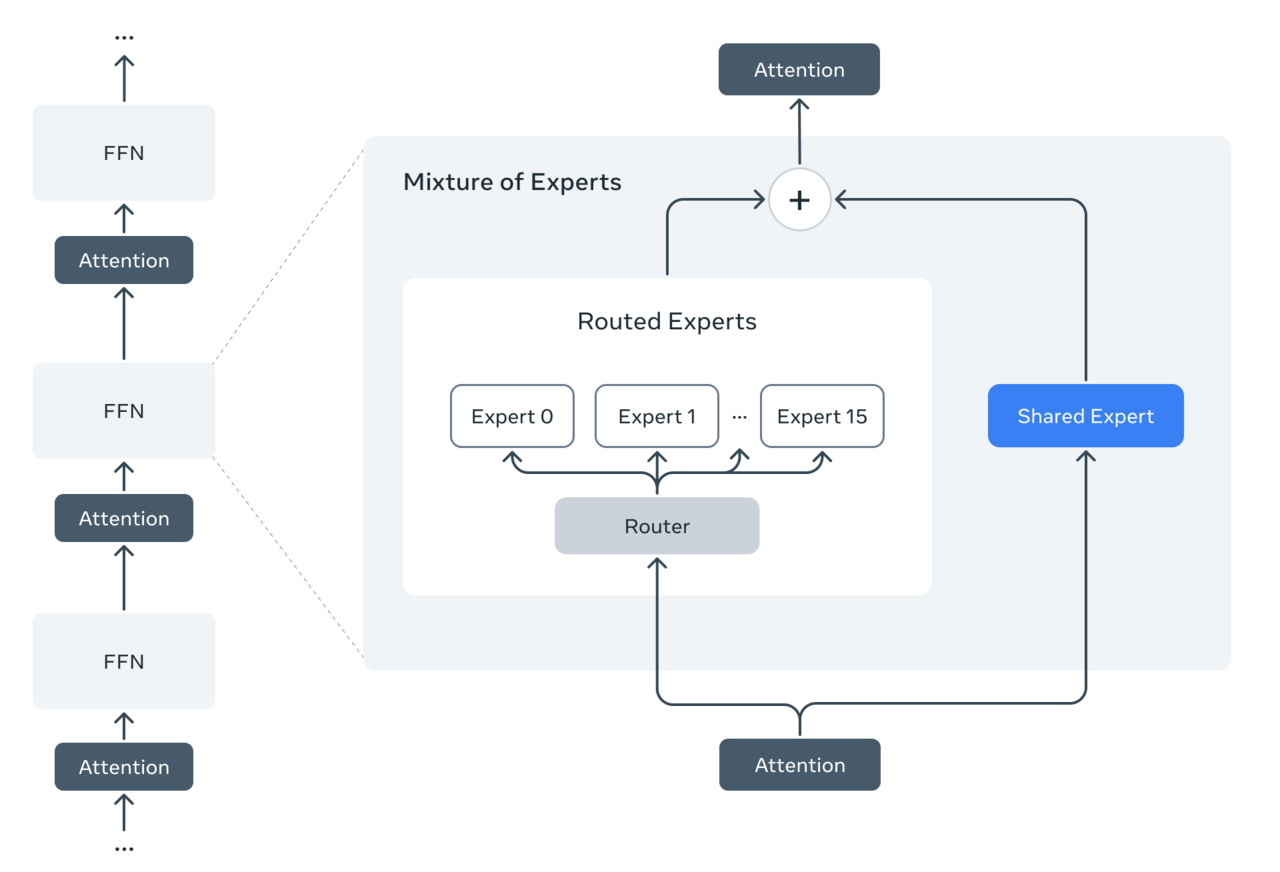

라마 4는 전문가 혼합(MoE)' 방식을 채택했다.

특히 컨텍스트 창의 크기가 무려 1000만(10M) 토큰이다. 기존 최대인 '제미나이'의 200만 토큰보다 5배나 큰 것으로, 최근 산업계의 컨텍스트 창 확대 요구에 맞춘 것이다. 그리고 스카우트와 매버릭은 베히모스를 '증류(distillation)'했다고 밝혔다. 딥시크 역시 R-1 출시 당시 증류한 소형 모델을 공개했다. 딥시크의 장점을 취하면서도 딥시크는 갖추지 못한 멀티모달 기능에 집중했다. 최근 트렌드인 추론 모델이 아니라는 점도 주목할만 하다. 다만 성능은 프론티어급 모델을 능가하거나 맞먹는다고 밝혔다.

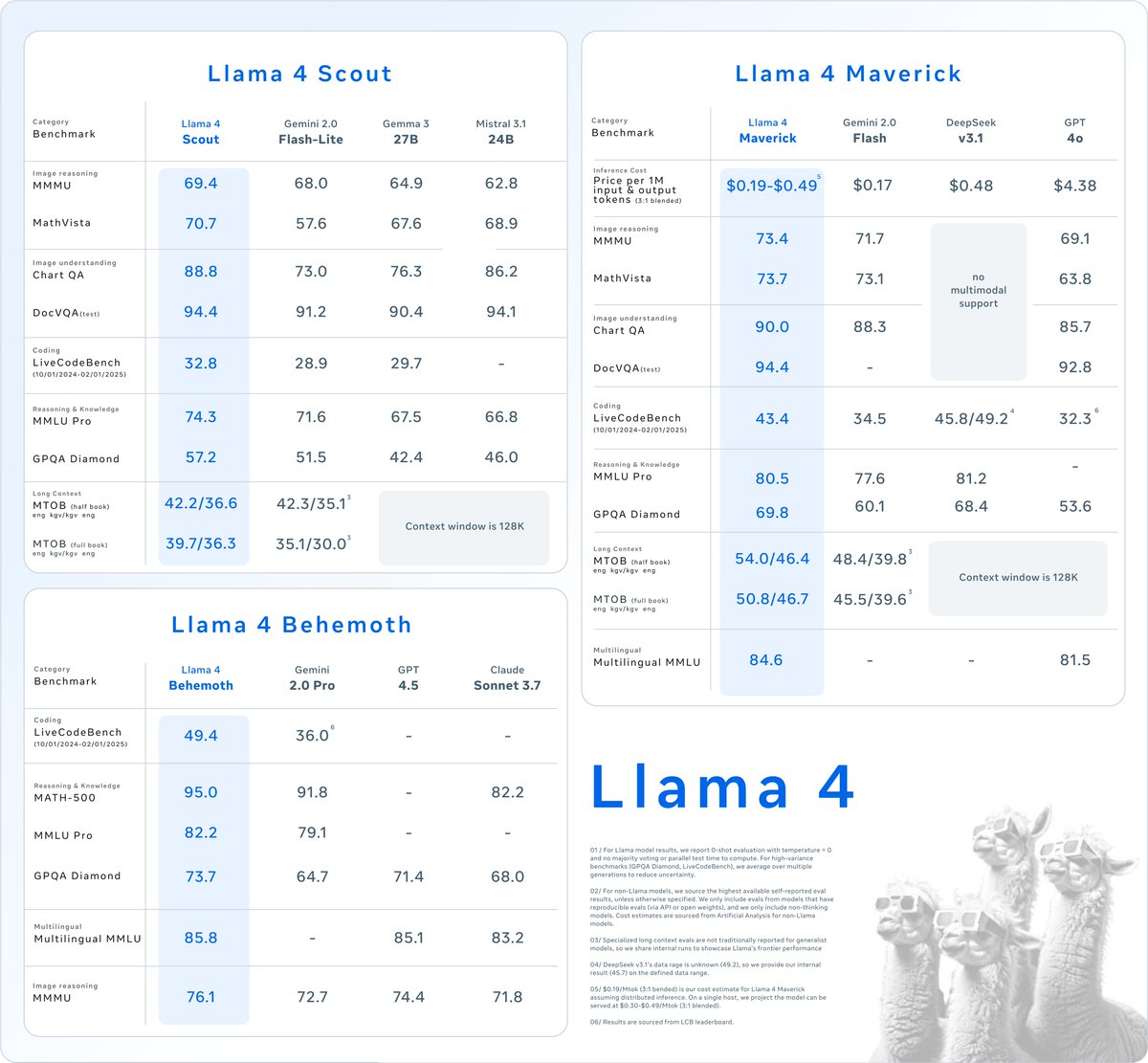

라마 4 스카우트는 16개의 전문가 모델로 구성됐으며, 활성 매개변수는 170억개(17B)다. 단일 엔비디아 'H100' GPU로 구동이 가능한 소형모델이지만, 이전 모든 세대의 라마 모델보다 성능이 뛰어나다고 설명했다. 벤치마크에서는 마이크로소프트의 '젬마 3'를 비롯해 '제미나이 플래시-라이트', '미스트랄 3.1' 등 동급 모델보다 뛰어난 성적을 거뒀다고 밝혔다. 사실상 주력 모델로 볼 수 있는 라마 4 매버릭은 총 매개변수 4000억개(400B) 중 활성 매개변수는 170억개다. 그러나 전문가 모델은 128개로, 스카우트의 8배 규모다

매버릭 역시 동급 최고의 멀티모달모델(LMM)이라고 강조했다. 특히 각종 벤치마크에서 현존 최고급의 LMM인 'GPT-4o'와 '제미나이 2.0 플래시'를 능가했다.

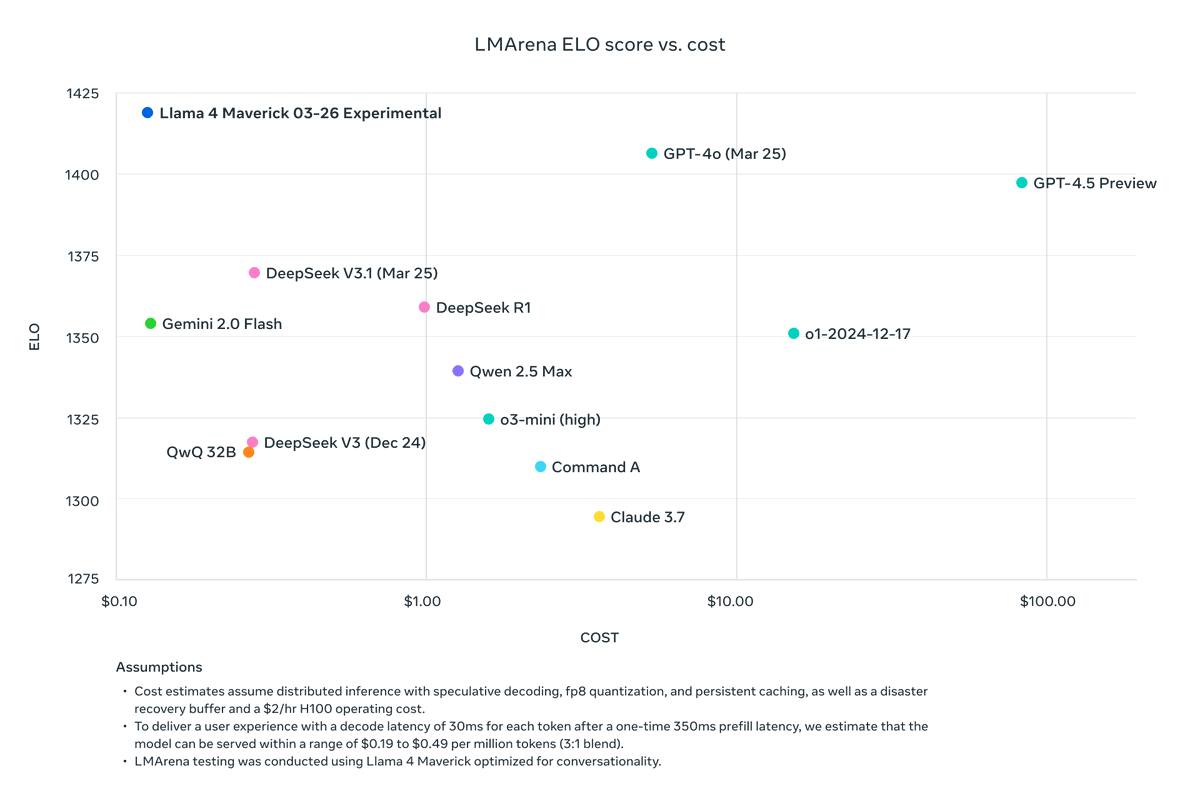

동시에 추론과 코딩에서는 딥시크-V3 최신 버전과 비슷한 결과를 달성했다고 밝혔다. V3에 비해 활성 매개변수의 절반도 안 된다고 밝혔다. 또 인간 선호도 평가인 LM아레나에서는 ELO 1417점을 기록, 동급 최고의 가성비를 제공한다고 덧붙였다.

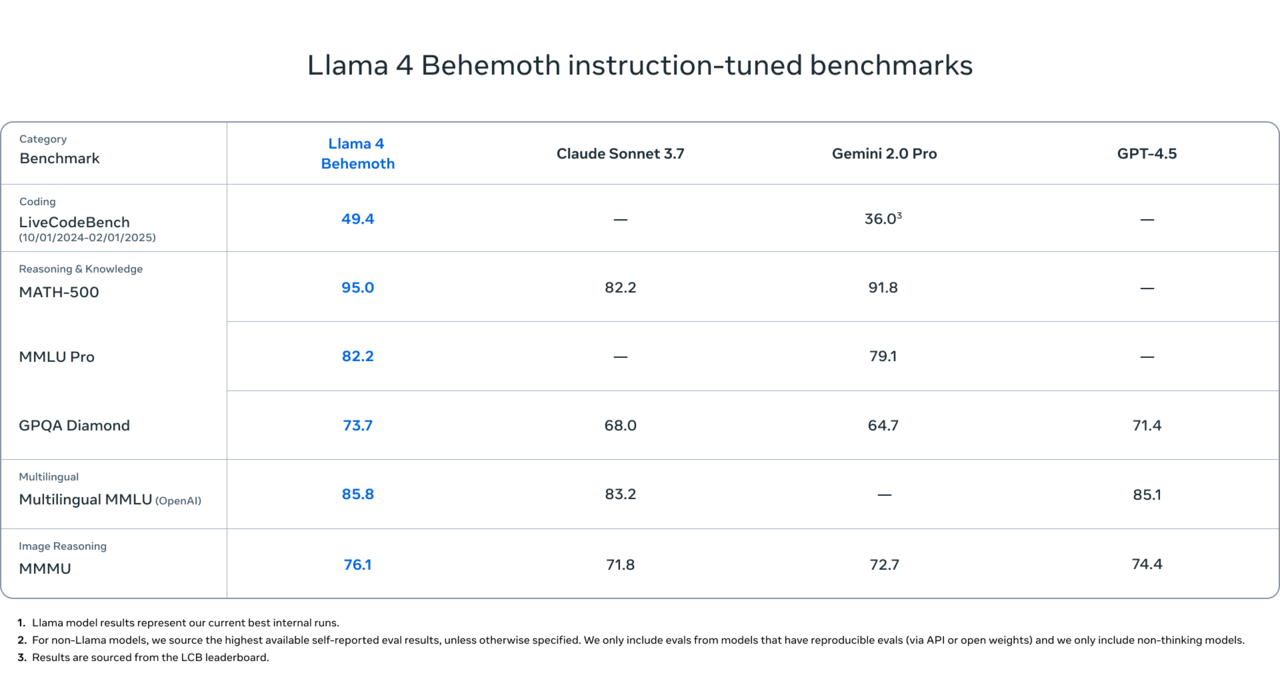

베히모스는 스카우트와 매버릭을 증류하는 데 사용한 '교사' 모델이다. 16개의 전문가와 2880억개(288B)의 활성 매개변수를 가진 "지금까지 등장한 가장 강력하고 똑똑한 모델 중 하나"라고 소개했다.

STEM 벤치마크에서는 최첨단 모델인 'GPT-4.5'와 '클로드 3.7 소네트', '제미나이 2.0 프로'보다 성능이 뛰어나다고 전했다. 메타는 "베히모스는 아직 훈련 중으로, 출시에 앞서 소개하게 돼 기쁘다"라고 밝혔다.

메타 스마트 안경 '하이퍼 노바'

이 안경은 기존 휴대폰 액세서리에 불과하던 보조 장치를 넘어, 휴대폰 없이도 사용할 수 있게 제작됐다. 이 디스플레이는 평소 정면을 쳐다보면 흐릿해지지만, 아래를 내려다보면 선명하게 등장한다. 제품을 켜면 디스플레이에는 회사 로고 등이 포함된 '부팅 화면'이 표시되며, 메타의 혼합현실 헤드셋 '퀘스트'와 비슷하게 구성된 홈 화면이 나타난다. 여기에는 사진 촬영과 사진 보기, 지도 전용 앱 등 모바일용 앱이 포함돼 있다. 메타의 메신저나 왓츠앱 등 통화 기능도 지원한다. 구글 안드로이드 마켓에 포함된 것으로, 메타가 별도의 스토어를 구축할 계획은 없는 것으로 알려졌다. 또 지난해 커넥트 행사에서 선보였던 손목밴드 컨트롤러를 제공할 예정이다. 이를 통해 간단한 손짓으로 내장 디스플레이에서 앱을 작동하는 장치다. '시러스(Ceres)'라는 코드명을 가진 메타의 야심작으로, 안경과 함께 제공된다. 9월 열리는 '커넥트' 행사에서 공개될 가능성이 크며, 계획은 변경될 수도 있다. 실제 메타는 프라이버시 침해를 막기 위해 카메라 없는 스마트 안경을 개발에 나섰다가, 얼마 전 이를 취소한 것으로 알려졌다.

이 밖에도 메타는 '슈퍼노바 2(Supernova 2)'라는 내부 디스플레이가 없는 안경도 제작 중이다. 기능은 기존 레이밴 안경과 흡사하지만, 외형이 고글형인 것으로 알려졌다. 이 제품도 지난 1월 블룸버그가 개발 중인 것을 확인했던 제품으로, 최근 공공장소에서 테스트를 시작했다고 전했다

Google Agent2Agent(A2A프로토콜 공개)

MCP와 A2A비교 원문 2024년 4월 10일

원문 Google이 새로운 에이전트-에이전트 프로토콜 A2A (Agent to Agent)를 오픈소스로 공개했습니다. Anthropic의 MCP와 유사하지만 목적과 구조 측면에서는 차별점이 존재합니다. MCP는 하나의 LLM이 외부 API나 도구를 활용하는데 중점을 둔 클라이언트로 쉽게 같은 MCP서버를 다양한 LLM으로 환경에 넣을 수 있습니다. A2A는 클라이언트 서버 구조로 서로 다른 에이전트들이 독립적으로 존재하며, 독립적인 에이전트들 간의 협업에 중점을 두었다고 합니다.

| Feature | A2A | MCP |

|---|---|---|

| Primary Use Case | Agent-to-agent communication and collaboration | Providing context and tools (external API/SDK) to LLMs |

| Core Architecture | Client-server (agent-to-agent) | Client-host-server (application-LLM-external resource) |

| Standard Interface | JSON specification, Agent Card, Tasks, Messages, Artifacts | JSON-RPC 2.0, Resources, Tools, Memory, Prompts |

| Key Features | Multimodal, dynamic, secure collaboration, task management, capability discovery | Modularity, security boundaries, reusability of connectors, SDKs, tool discovery |

| Communication Protocol | HTTP, JSON-RPC, SSE | JSON-RPC 2.0 over stdio, HTTP with SSE (or streamable HTTP) |

| Performance Focus | Asynchronous communication for load handling | Efficient context management, parallel processing, caching for high throughput |

| Adoption & Community | Good initial industry support, nascent ecosystem | Substantial adoption from entire industry, fast growing community |

2025-04-13

2025-04-13 5 min read

5 min read